内容纲要

概要说明

本案例介绍两种在TDH 集群中为某个节点更换数据磁盘,或者添加数据磁盘的操作方法:

- 节点某一块数据磁盘故障需要剔除该硬盘;

- 节点的数据磁盘空间不足,需要添加一块新的数据盘;

详细说明

TDH 集群中节点更换坏盘的操作主要分为以下几个步骤:

- 检查坏盘被哪些服务使用,将使用该磁盘的服务对应的角色停掉

- 将该坏盘从角色配置中删除,并配置服务

- 服务器添加新的磁盘,做好格式化和目录挂载

- 将新的磁盘添加到服务的配置项中,并配置服务

- 重启服务

操作说明

- 如果集群只需要剔除旧盘,只需要做1、2、5即可;

- 如果是集群只是扩容新磁盘,只需要做3、4、5即可;

- 如果是集群需要剔除坏盘,重新添加新磁盘,5步需要全做;

详细步骤

1、检查坏盘被哪些服务使用,将使用该磁盘的服务对应的角色停掉

先检查磁盘是否作为集群hdfs、inceptor、yarn组件的数据盘或者元数据盘在使用,相关的服务以及配置项:

- hdfs:dfs.datanode.data.dir、dfs.namenode.name.dir

- inceptor:ngmr.fastdisk.dir、ngmr.localdir

- yarn:yarn.nodemanager.local-dirs、yarn.nodemanager.log-dirs

例如检查 hdfs 服务数据路径或者元数据路径是否使用了坏盘,依次检查inceptor、yarn 等服务的。

如果需要更换的节点磁盘在 hdfs 和 inceptor 、yarn 的这几个参数均有配置,请先停止该节点上的 datanode 角色、NameNode 角色、inceptor server 角色、nodemanager、resourcemagaer;

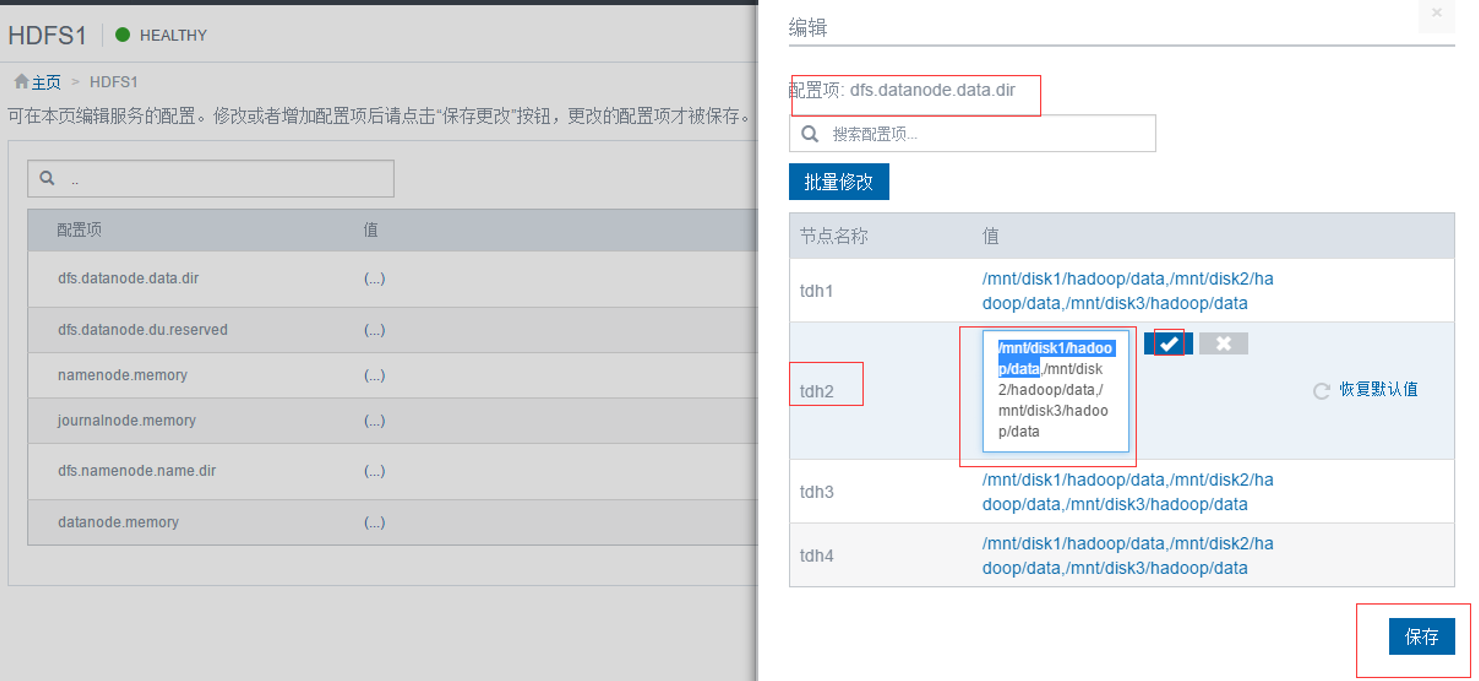

2、将该坏盘从角色配置中删除,并配置服务

在以上几个参数的配置项中移除挂载该磁盘的目录,具体根据集群实际环境而定。

如果只作为数据盘在使用 (只有参数 dfs.datanode.data.dir 包含节点坏盘挂载的目录),只需要停 datanode 角色即可,移除 dfs.datanode.data.dir参数中关于磁盘配置。

修改完参数后,配置页面 “保存更改”,“更多操作”,“配置服务”使其生效;

然后到对应节点卸载磁盘:umount /dev/sdx /mnt/diskx,清除故障盘完成

3、服务器添加新的磁盘,做好格式化和目录挂载

请确保磁盘已经格式化(mkfs.xfs -f -n ftype=1 /dev/<p_name>),确认过可以正常读写,然后挂载到 /mnt/diskx 目录,并且写入/etc/fstab。

4、将新的磁盘添加到服务的配置项中,并配置服务

到8180页面,hdfs、inceptor、yarn 组件配置参数中,根据格式将新磁盘的挂载路径添加进去,页面保存修改,“更多操作”中“配置服务”使其生效

5、启动服务

重启 datanode、yarn、inceptor server 相关角色