内容纲要

概要描述

TDH 4.3.x 版本,因为部署时间较早,数据节点磁盘容量规划较小,导致 HDFS 可用容量较低。集群运行一段时间后,随着生产数据的持续写入,面会出现磁盘空间严重不足的情况,磁盘已用空间超过一定比例(90%)后,会导致大数据平台运行异常;本案例针对短时间内无法完成扩容的情况,提供一个临时的解决方案;

可以使用降低数据备份(数据默认3备份)的办法临时释放部分可用空间,保障平台的正常运行,为集群扩容争取时间。

详细说明

此方法仅为应急使用,同一集群只能使用一次,遇到磁盘空间不足的情况,建议尽快扩容,增加可用空间。

1、访问集群任意一个数据节点

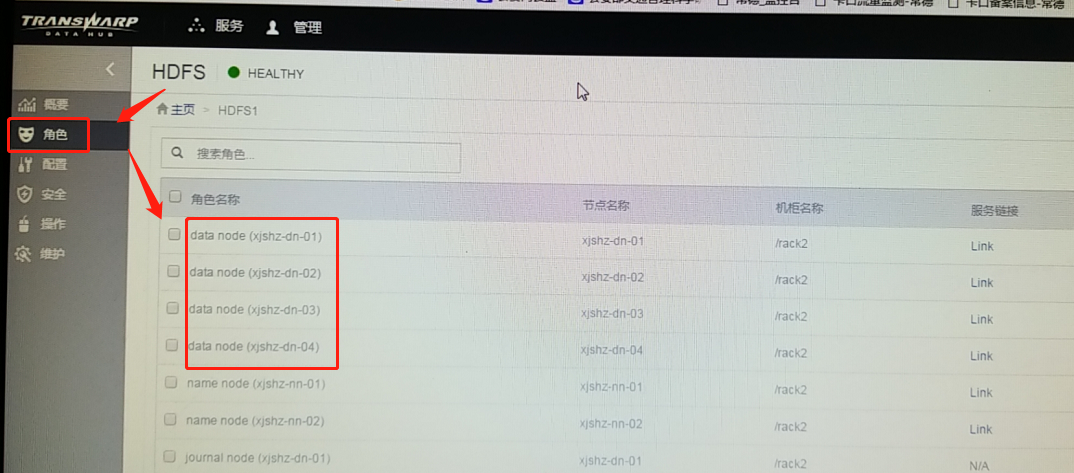

在大数据管理页面(8180 端口对应的页面)点击服务进入 HDFS 服务 页面,然后点击左侧 角色 图标,找到 datanode 服务所在节点,使用 shell 工具连接其中任意一个节点;

2、在数据节点执行下面命令降低数据备份

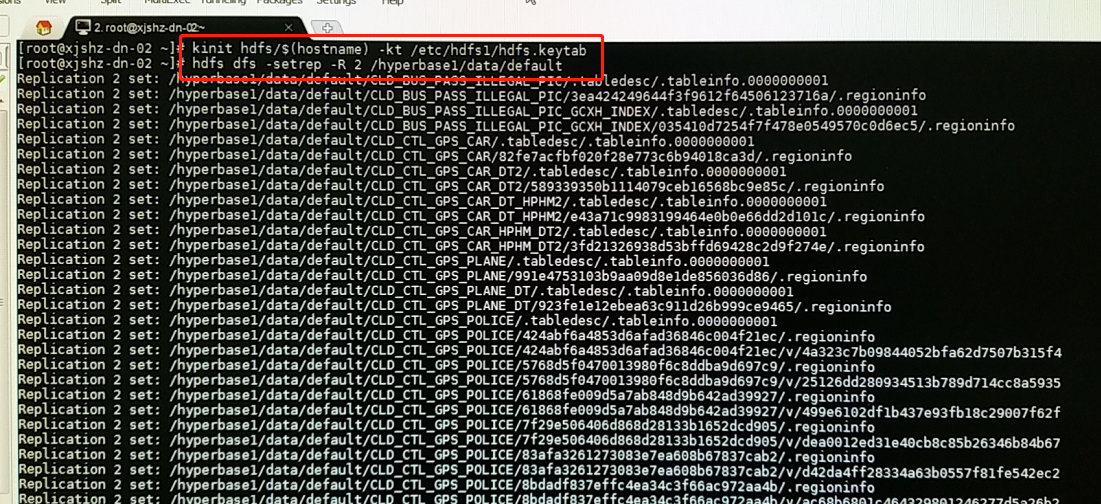

先kinit安全通过安全认证

**kinit hdfs/$(hostname) -kt /etc/hdfs1/hdfs.keytab**然后使用 setrep 命令将默认的3备份数据降低为2备份,进而释放部分磁盘空间,setrep 命令参考 hadoop 的常用 fsshell 命令

hdfs dfs -setrep -R 2 /hyperbase1/data/default

此命令是修改 /hyperbase1/data/default 路径下所有文件的副本数量为 2

正常执行情况下,会如上图显示执行过程,耐心等待执行完毕即可。

3、等待执行完毕后,确认磁盘空间是否释放

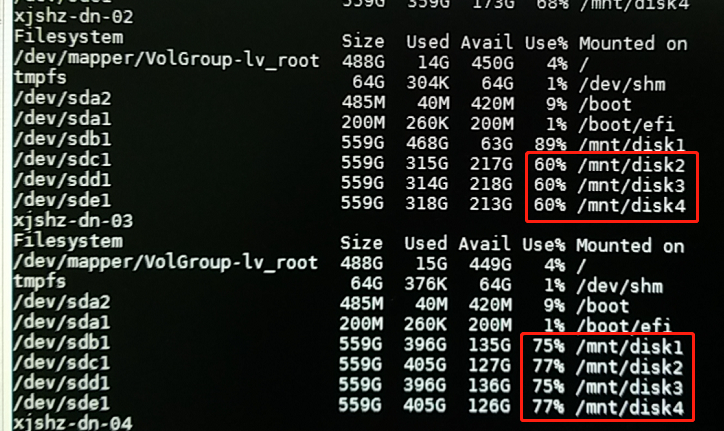

在所有 datanode 角色所在数据节点使用 df -h 命令,即可查看磁盘空间占用情况